VI. ПОТЕНЦИАЛЬНЫЕ РЕШЕНИЯ И БУДУЩАЯ ДОРОЖНАЯ КАРТА

Потенциальные решения (как показано наFigure 13) для этих вызовов и ограничений ИИ-агентов и Агентного ИИ суммированы в следующих пунктах:

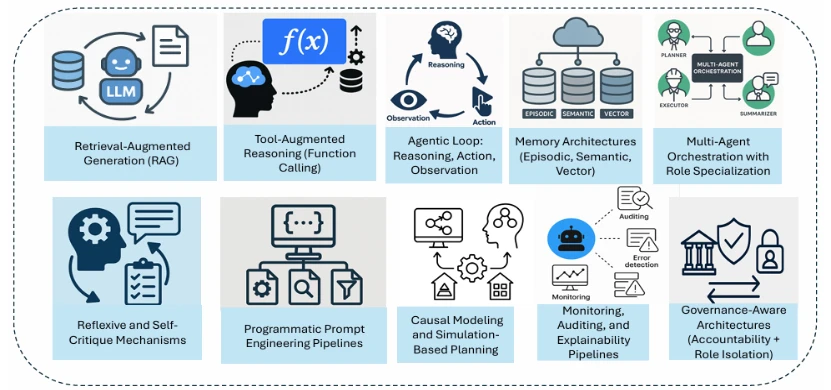

Figure 13

Десять новых архитектурных и алгоритмических решений, таких как RAG, использование инструментов, оркестровка и рефлексивные механизмы, направленные на повышение надежности, масштабируемости и объяснимости в обеих парадигмах (ИИ-агенты и Агентный ИИ).

1) Генерация с расширенным извлечением (RAG)

Для ИИ-агентов Генерация с расширенным извлечением смягчает галлюцинации и расширяет статические знания БЯМ, обосновывая результаты данными в реальном времени [203]. Встраивая запросы пользователей и извлекая семантически релевантные документы из векторных баз данных, таких как FAISS или Pinecone, агенты могут генерировать контекстуально валидные ответы, основанные на внешних фактах. Это особенно эффективно в таких областях, как корпоративный поиск и поддержка клиентов, где точность и актуальность знаний имеют решающее значение.

В системах Агентного ИИ RAG служит общим механизмом обоснования для всех агентов. Например, агент-суммаризатор может полагаться на агент-извлекатель для доступа к новейшим научным статьям перед созданием синтеза. Постоянная, доступная для запросов память позволяет распределенным агентам работать на унифицированном семантическом уровне, смягчая несогласованности из-за расходящихся контекстных представлений. При реализации в многоагентной системе RAG помогает поддерживать общую истинность, улучшать согласование целей и уменьшать распространение дезинформации между агентами.

2) Рассуждение с дополненными инструментами (Function Calling)

ИИ-агенты значительно выигрывают от вызова функций, что расширяет их способность взаимодействовать с реальными системами [167], [204]. Агенты могут запрашивать API, запускать локальные скрипты или получать доступ к структурированным базам данных, тем самым превращая БЯМ из статических предикторов в интерактивные решатели проблем [131], [162]. Это позволяет им динамически извлекать прогнозы погоды, планировать встречи или выполнять вычисления на основе Python, выходя за рамки возможностей чистого языкового моделирования.

Для Агентного ИИ вызов функций поддерживает автономию на уровне агента и дифференциацию ролей. Агенты внутри команды могут использовать API для вызова действий, специфичных для предметной области, таких как запрос клинических баз данных или генерация визуальных диаграмм на основе назначенных ролей. Вызовы функций становятся частью оркестрированного конвейера, обеспечивая плавное делегирование между агентами [205]. Это структурированное взаимодействие уменьшает двусмысленность при передаче задач и способствует формированию более четких поведенческих границ, особенно при интеграции с протоколами валидации или механизмами наблюдения [14], [18].

3) Агентный цикл: рассуждение, действие, наблюдение

ИИ-агенты часто страдают от ограничений однократного вывода. Шаблон ReAct вводит итерационный цикл, в котором агенты рассуждают о задачах, действуют, вызывая инструменты или API, а затем наблюдают результаты перед продолжением. Этот цикл обратной связи позволяет получить более обдуманное, контекстно-чувствительное поведение. Например, агент может проверять извлеченные данные перед составлением сводки, тем самым уменьшая галлюцинации и логические ошибки. В Агентном ИИ этот шаблон критически важен для совместной когерентности. ReAct позволяет агентам динамически оценивать зависимости, рассуждая над промежуточными состояниями, повторно вызывая инструменты при необходимости и корректируя решения по мере развития среды. Этот цикл становится более сложным в многоагентных средах, где наблюдение каждого агента должно быть согласовано с результатами других. Общая память и последовательное логирование здесь важны, обеспечивая, чтобы рефлексивная способность системы не фрагментировалась между агентами [132].

4) Архитектуры памяти (Эпизодическая, Семантическая, Векторная)

ИИ-агенты сталкиваются с ограничениями в долгосрочном планировании и непрерывности сеансов. Архитектуры памяти решают эту проблему, сохраняя информацию между задачами [206]. Эпизодическая память позволяет агентам вспоминать предыдущие действия и обратную связь, семантическая память кодирует структурированные доменные знания, а векторная память обеспечивает поиск по сходству [207]. Эти элементы являются ключевыми для персонализации и адаптивного принятия решений при повторных взаимодействиях. Системы Агентного ИИ требуют ещё более сложных моделей памяти из-за распределенного управления состоянием. Каждый агент может поддерживать локальную память, одновременно получая доступ к общей глобальной памяти для координации. Например, агент планирования может использовать векторную память для вызова предыдущих рабочих процессов, в то время как QA-агент обращается к семантической памяти для проверки фактов. Синхронизация доступа к памяти и обновлений между агентами улучшает согласованность, обеспечивает контекстно-зависимую коммуникацию и поддерживает долгосрочное системное планирование.

5) Многоагентная оркестровка со специализацией ролей

В ИИ-агентах сложность задач часто решается с помощью модульных шаблонов запросов или условной логики. Однако, по мере увеличения разнообразия задач, один агент может быть перегружен [208], [209]. Разделение задач на подкомпоненты (например, планировщик, сумматор) позволяет легковесную оркестровку даже в одноагентных системах путем имитации разбитого на разделы рассуждения. В Агентном ИИ оркестровка является центральной. Мета-агент или оркестратор распределяет задачи между специализированными агентами, каждый из которых обладает своими уникальными возможностями. Системы, такие как MetaGPT и ChatDev, являются примером: агенты эмулируют роли, такие как генеральный директор, инженер или рецензент, и взаимодействуют посредством структурированного обмена сообщениями. Этот модульный подход улучшает интерпретируемость, масштабируемость и изоляцию ошибок, гарантируя, что сбои в одном агенте не каскадируются без механизмов сдерживания от оркестратора.

6) Рефлексивные механизмы и механизмы самокритики

ИИ-агенты часто терпят неудачу молча или распространяют ошибки. Рефлексивные механизмы вводят возможность самооценки [210], [211]. После выполнения задачи агенты могут критиковать свои собственные результаты, используя вторичный проход рассуждений, повышая надежность и снижая частоту ошибок. Например, агент-юрист может проверять, соответствует ли его составленный пункт ранее принятым судебным решениям, перед отправкой. Для Агентного ИИ рефлексивность распространяется за пределы самокритики до межагентной оценки. Агенты могут просматривать результаты друг друга, например, агент-верификатор, проверяющий работу сумматора. Такие паттерны, основанные на рефлексии, также поддерживают итеративное улучшение и адаптивное перепланирование, особенно при интеграции с журналами памяти или очередями обратной связи [213], [214].

7) Программируемые конвейеры для инженерии запросов

Ручная настройка запросов приводит к хрупкости и снижает воспроизводимость в ИИ-агентах. Программируемые конвейеры автоматизируют этот процесс, используя шаблоны задач, заполнители контекста и переменные, дополненные извлечением [215], [216]. Эти динамические запросы структурируются на основе типа задачи, роли агента или запроса пользователя, улучшая обобщение и уменьшая режимы сбоев, связанные с изменчивостью запросов. В Агентном ИИ конвейеры запросов обеспечивают масштабируемую, роле-согласованную коммуникацию. Каждый тип агента (например, планировщик, извлекатель, сумматор) может генерировать или потреблять структурированные запросы, адаптированные к его функции. Автоматизируя форматирование сообщений, отслеживание зависимостей и семантическое выравнивание, программное запросирование предотвращает дрейф координации и обеспечивает согласованное рассуждение между различными агентами в реальном времени [14], [167].

8) Причинное моделирование и планирование на основе симуляции

ИИ-агенты часто работают на основе статистических корреляций, а не причинных моделей, что приводит к плохому обобщению при изменении распределений. Встраивание причинно-следственного вывода позволяет агентам различать корреляцию и причинность, симулировать вмешательства и планировать более надежно. Например, в сценариях цепочки поставок агент, осведомленный о причинно-следственных связях, может симулировать последующее влияние задержек отгрузки. В Агентном ИИ причинное рассуждение жизненно важно для безопасной координации и восстановления после ошибок. Агенты должны предвидеть, как их действия повлияют на других, что требует причинных графов, симуляционных сред или слоев байесовского вывода. Например, агент по планированию может симулировать различные стратегии и сообщать о вероятных результатах другим, способствуя стратегическому согласованию и избегая непреднамеренного эмерджентного поведения. Для обеспечения совместного поведения агенты могут управляться структурированным подходом к планированию, таким как STRIPS или PDDL (Planning Domain Definition Language), где среда моделируется с определенными действиями, предусловиями и эффектами. Зависимости между агентами закодированы таким образом, что действие одного агента позволяет другому, а централизованный или распределенный планировщик гарантирует, что все агенты способствуют общей цели. Эта унифицированная структура поддерживает стратегическое согласование, предвосхищающее планирование и минимизирует непреднамеренные эмерджентные поведения в многоагентных системах.

9) Конвейеры мониторинга, аудита и объяснимости

ИИ-агентам не хватает прозрачности, что затрудняет отладку и доверие. Системы журналирования, которые записывают запросы, вызовы инструментов, обновления памяти и выходные данные, позволяют проводить посторонний анализ и настройку производительности. Эти записи помогают разработчикам отслеживать ошибки, уточнять поведение и обеспечивать соответствие рекомендациям по использованию, что особенно критично в корпоративных или юридических областях. Для Агентного ИИ журналирование и объяснимость экспоненциально важнее. При асинхронном взаимодействии нескольких агентов журналы аудита необходимы для определения того, какой агент вызвал ошибку и при каких условиях. Конвейеры объяснимости, которые интегрируются между агентами (например, визуализация временной шкалы или воспроизведение диалогов), являются ключевыми для обеспечения безопасности, особенно в регулируемых или многосторонних средах.

10) Архитектуры, ориентированные на управление (подотчетность и изоляция ролей)

ИИ-агентам в настоящее время не хватает встроенных механизмов защиты для этического соответствия или атрибуции ошибок. Архитектуры, ориентированные на управление, вводят контроль доступа на основе ролей, изоляцию песочницы и разрешение идентичности, чтобы гарантировать, что агенты действуют в рамках своей компетенции, а их решения могут быть проверены и отозваны. Эти структуры снижают риски в чувствительных приложениях, таких как здравоохранение или финансы. В Агентном ИИ управление должно масштабироваться по ролям, агентам и рабочим процессам. Изоляция ролей предотвращает превышение полномочий недобросовестными агентами, в то время как механизмы подотчетности возлагают ответственность за решения и отслеживают причинно-следственные связи между агентами. Протоколы соответствия, этические проверки согласованности и аутентификация агентов обеспечивают безопасность в совместных средах, подготавливая почву для надежных экосистем ИИ.

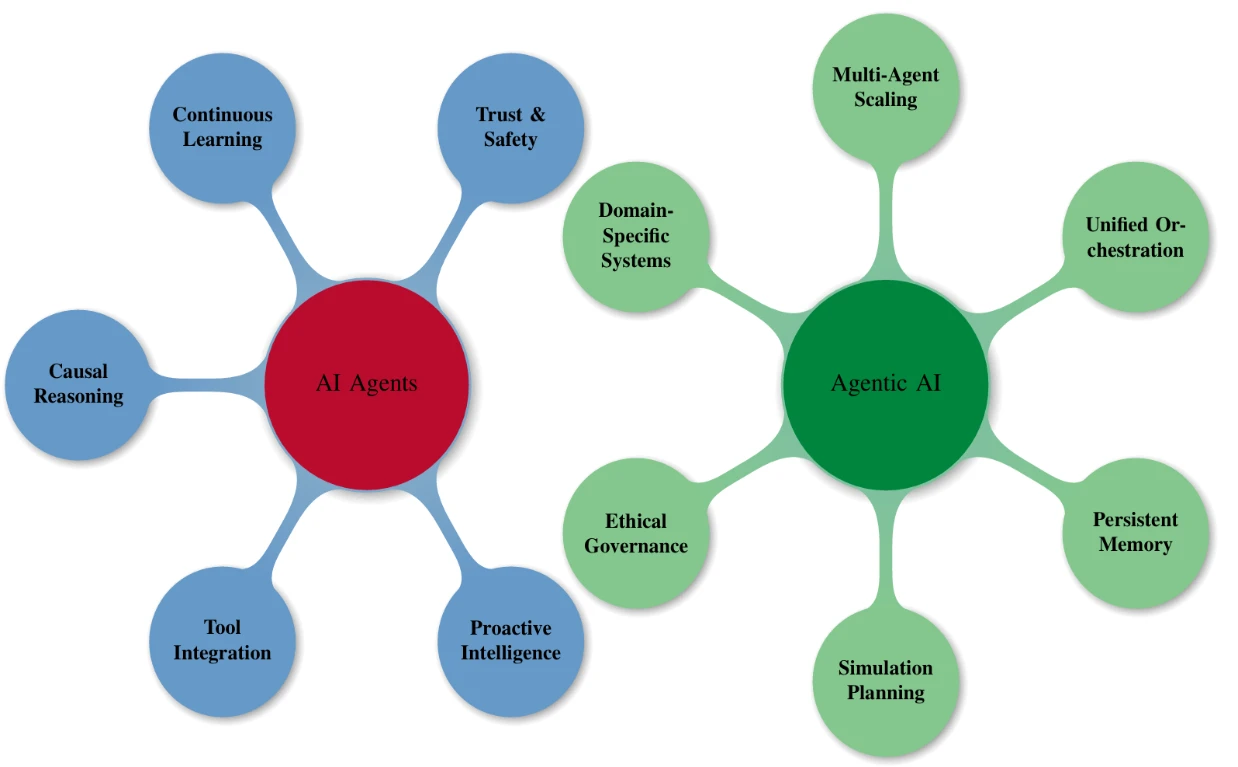

Figure 14

Визуализация дорожной карты будущего для ИИ-агентов и Агентного ИИ.

ИИ-агенты, как ожидается, будут значительно развиваться благодаря улучшенному модульному интеллекту, сфокусированному на пяти ключевых областях, как показано на

Figure 14

: проактивное рассуждение, интеграция инструментов, причинный вывод, непрерывное обучение и операции, ориентированные на доверие. Первый трансформационный этап включает переход от реактивного к проактивному интеллекту, где агенты инициируют задачи на основе изученных шаблонов, контекстуальных подсказок или скрытых целей, а не ожидают явных запросов. Это продвижение сильно зависит от надежной интеграции инструментов, позволяющей агентам динамически взаимодействовать с внешними системами, такими как базы данных, API или симуляционные среды, для выполнения сложных пользовательских задач. Не менее критичным является развитие причинного рассуждения, которое позволит агентам выйти за рамки статистической корреляции, поддерживая вывод причинно-следственных связей, необходимых для задач, связанных с диагностикой, планированием или прогнозированием. Для поддержания актуальности со временем агенты должны применять фреймворки непрерывного обучения, включая циклы обратной связи и эпизодическую память, чтобы адаптировать свое поведение в разных сессиях и средах. Наконец, для формирования доверия пользователей агенты должны приоритизировать механизмы доверия и безопасности посредством проверяемого логирования вывода, обнаружения предвзятости и этических барьеров, особенно по мере увеличения их автономии. В совокупности эти пути переопределят ИИ-агентов от статических инструментов до адаптивных когнитивных систем, способных к автономной, но контролируемой работе в динамических цифровых средах.

Агентный ИИ, как естественное расширение этих основ, акцентирует внимание на совместном интеллекте через многоагентную координацию, контекстуальную постоянность и предметно-ориентированную оркестровку. Будущие системы (правая частьFigure 14) будут демонстрировать масштабирование многоагентных систем, позволяя специализированным агентам работать параллельно под распределенным контролем для решения сложных проблем, имитируя рабочие процессы, основанные на командах людей. Это требует слоя унифицированной оркестровки, где мета-агенты или оркестраторы динамически назначают роли, отслеживают зависимости задач и разрешают конфликты между подчиненными агентами. Устойчивая производительность со временем зависит от архитектур постоянной памяти, которые сохраняют семантические, эпизодические и общие знания для агентов, чтобы координировать долгосрочные задачи и поддерживать осведомленность о состоянии. Ожидается, что планирование на основе симуляции станет ключевой особенностью, позволяя коллективам агентов тестировать гипотетические стратегии, прогнозировать последствия и оптимизировать результаты до реального выполнения. Более того, этические рамки управления будут необходимы для обеспечения ответственного развертывания, определяющие подотчетность, надзор и согласование ценностей в автономных агентских сетях. Наконец, в таких областях, как право, медицина и цепочки поставок, появятся специализированные доменно-специфические системы, использующие контекстуальную специализацию для превосходства над универсальными агентами. Эта перспектива позиционирует Агентный ИИ не просто как координационный уровень поверх ИИ-агентов, а как новую парадигму коллективного машинного интеллекта с адаптивным планированием, рекурсивным рассуждением и совместным познанием в своей основе.

Трансформационное направление для будущих систем ИИ представлено фреймворком Absolute Zero: Reinforced Self-play Reasoning with Zero Data (AZR), который переосмысливает парадигму обучения для ИИ-агентов и Агентного ИИ, устраняя зависимость от внешних наборов данных [217]. Традиционно как ИИ-агенты, так и архитектуры Агентного ИИ полагались на данные, аннотированные человеком, статические базы знаний или предварительно сконфигурированные среды – факторы, которые ограничивают масштабируемость и адаптивность в открытых средах. AZR решает это ограничение, позволяя агентам автономно генерировать, валидировать и решать свои задачи, используя проверяемые механизмы обратной связи (например, выполнение кода) для обоснования обучения. Этот саморазвивающийся механизм открывает путь к по-настоящему автономным рассуждающим агентам, способным к самообучению и адаптации в динамичных, мало данных средах.

В контексте Агентного ИИ — где несколько специализированных агентов сотрудничают в оркестрованных рабочих процессах — AZR закладывает основу для агентов, чтобы они не только специализировались, но и совместно развивались. Например, конвейеры научных исследований могли бы состоять из агентов, которые выдвигают гипотезы, запускают симуляции, валидируют результаты и пересматривают стратегии — полностью через самообучение и проверяемое рассуждение, без постоянного надзора человека. Интегрируя парадигму AZR, такие системы могут поддерживать постоянный рост, уточнение знаний и гибкость задач с течением времени. В конечном итоге, AZR подчёркивает будущее, в котором ИИ-агенты переходят от статических, предварительно обученных инструментов к интеллектуальным, самосовершенствующимся экосистемам — позиционируя как ИИ-агентов, так и Агентный ИИ в авангарде искусственного интеллекта следующего поколения.